1. リモートデスクトップ

HuggingFace や CivitAI からモデルをダウンロードする際に、 リモートデスクトップ環境があると非常に便利です。 ターミナルだけでも作業は可能ですが、快適に進めようとすると工夫が必要になります。

また、後述する LM Studio を利用する場合は、リモートデスクトップは ほぼ必須と考えて良いです。GUIベースでモデル管理・設定を行うためです。

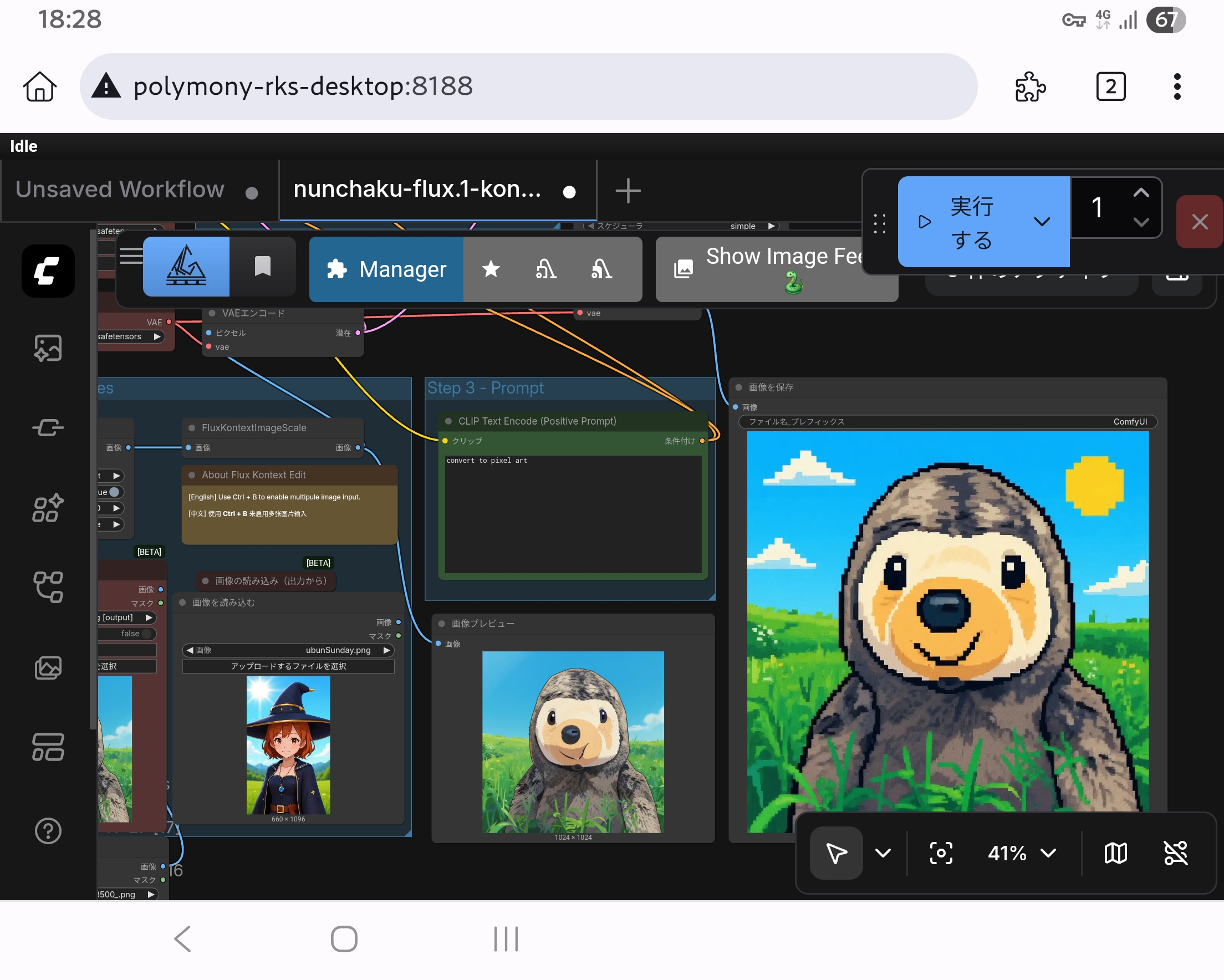

2. Tailscale

Tailscale を使うと、WebUI や ComfyUI、Ollama、SSH 接続などを 簡単・安定・高速に扱えるようになります。

- 設定が簡単(ポート開放などの煩雑な作業が不要)

- 時間経過・スリープ・一時的な通信切断があっても接続が切れにくい

- TCP ではなく UDP ベースのため高速

例えば、自宅のメインマシン(母艦)に Tailscale 経由で接続し、 外出先から GPU タスクを回すような運用もできます。 自宅でも外でも、好きな場所で生成タスクを投げられるのが大きなメリットです。

Fooocus のような WebUI 系ツールであれば、スマホのブラウザからでも快適に利用でき、 「ちょっと遊ぶ」用途でも重宝します。

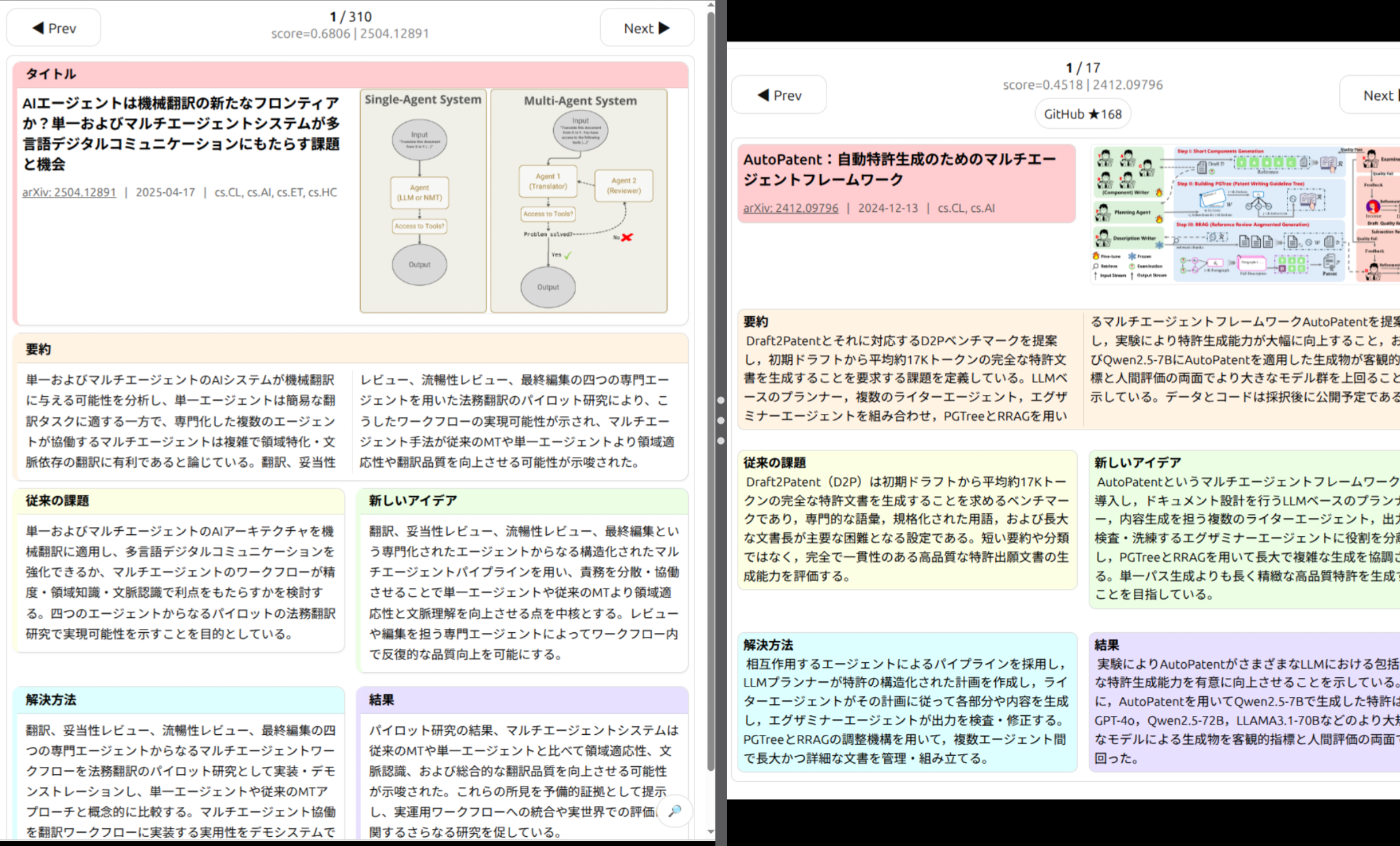

3. ComfyUI

ComfyUI を使うと、最新の画像・動画生成モデルや そのワークフローをノードベースで柔軟に試すことができます。 生成の流れを「視覚的に」観察したり、部分的に差し替えてアレンジしたりといったことが容易です。

応用例:

- 人物だけを YOLO 的に検出してオブジェクトとして扱い、削除して Inpaint

- ChatGPT と連携して英語プロンプトへの変換や、“気の利いた”プロンプト自動生成を行う

- 高度な自動化ワークフロー: 画像生成(Flux 1.) → 動画用プロンプト・台詞生成(ChatGPT) → ボイス生成(Voicepeak) → 動画生成(FramePack) → 口パク調整(Wan2.2-S2V)…といった流れを一気通貫で構築

「とりあえず色々つないでみたい」「自分専用のパイプラインを作りたい」という人には、 かなり相性の良いツールです。

4. LM Studio / Ollama + VSCode & Cline

ComfyUI が拡散型の画像・動画生成に強いのに対し、 言語モデル(ChatGPT のような LLM)をローカルで動かすには LM Studio や Ollama が便利です。

LM Studio

GUI ベースでローカルモデルを導入でき、VSCode の拡張ストアのような感覚で さまざまなモデルを試せます。モデルの管理・切り替えが視覚的で分かりやすいのが特徴です。

Ollama

ターミナルとの相性が良く、スクリプトや CLI ベースのワークフローに組み込みやすいです。 Docker 的な感覚でモデルを pull / run して使うことができます。

VSCode + Cline

VSCode の拡張機能 Cline を組み合わせると、 エージェント的なコード支援や自動化を手軽に試せます。 商用API・ローカルモデルを切り替えながら同じワークスペースで動かせるため、 「ローカルだけでどこまでやれるか」を検証したい人にも向いています。

ローカルモデルで Cline を活用する場合は、LM Studio もしくは Ollama のどちらかを 併用する構成が基本になります(他の選択肢もありますが、この辺りがメジャーどころです)。

5. Jupyter Notebook

Google Colab が有名ですが、そのローカル版に近い感覚で使えるのが Jupyter Notebook です(歴史的には Jupyter の方が先行しています)。

例えば、最新モデルに対してまだ ComfyUI 用のワークフローが整備されておらず、 Diffusers 実装だけが公開されているような状況では、 Jupyter Notebook 上で直接 Python を書いて実験するのが手っ取り早いです。

ちょっとした Python の検証や、モデルの入出力の確認用としても相性が良く、 「まずは Notebook 上で動かしてから、本格的なパイプラインに組み込む」 といったプロトタイピングにも向いています。

Google Colab を使うのももちろん有効ですが、 ローカルGPUを活かす前提であれば、手元環境の Jupyter Notebook を 一つ用意しておくと何かと便利です。